In letzter Zeit ist Künstliche Intelligenz (KI, auch artificial intelligence oder AI) in aller Munde. KI schreibt Zeitungsartikel, malt Bilder, steuert Roboter in Fabriken. Wenn wir noch ein bisschen warten, schmiert KI auch das Frühstücksbrot, könnte man ironisch anmerken (und vielleicht lernt sie das tatsächlich auch noch).

In diesem Blogbeitrag soll es jedoch nicht darum gehen, was KI alles kann, sondern gewissermaßen um das Gegenteil - darum, was KI (bisher) nicht kann und wozu man das ausnutzen kann. Thema sind automatisierte Turing-Tests, sogenannte CAPTCHAs.

Klar definierte und strukturierte Aufgaben können Computer schon seit Jahrzehnten erledigen. Dazu gehört beispielsweise das Ausfüllen von Web-Formularen. Nehme diesen Text, kopiere ihn in das Eingabefeld, das mit “Ihre Nachricht” beschriftet ist. Finde den Button, der mit “Absenden” beschriftet ist, und klicke ihn. Viel mehr muss man nicht können, um ein Kontakt-Formular auf einer Website zu benutzen. Und weil Computer viel schneller sind als Menschen, kann ein solcher Mechanismus ein Kontaktformular schon mal zigtausendfach pro Sekunde ausfüllen und abschicken, ausfüllen und abschicken, ausfüllen und…

Wer ist hier die Maschine?

Gesucht sind also Möglichkeiten, Web-Formulare gegen solchen Missbrauch abzusichern. Ein bislang häufig verwendetes Verfahren nutzt aus, dass es (derzeit) Dinge gibt, die Menschen können, automatisierte Systeme aber nicht, oder jedenfalls längst nicht so gut. Auf dieser Basis entwickelt man Tests, die zwischen einem menschlichen Benutzer und einem automatisierten System unterscheiden sollen. Besteht ein Benutzer den Test, wird er als Mensch eingestuft und kann das Formular abschicken. Besteht ein Benutzer den Test nicht, wird er als Automat eingestuft, und seine Eingaben werden verworfen.

Die Idee hinter dieser Unterscheidung geht auf einen der Pioniere der KI und der Informatik insgesamt zurück, auf Alan Turing. Der hatte sich bereits 1950 mit der Frage beschäftigt, wie man feststellen könnte, ob eine Maschine denken kann. Dazu entwarf Turing ein sogenanntes “Imitationsspiel”. Später wurde eine vereinfachte Version als “Turing-Test” bekannt.

Das Grundprinzip ist einfach: Eine Versuchsperson ist mit zwei Kommunikationspartnern verbunden, ohne Sicht- oder Hörkontakt. Einer der beiden Partner ist ein Mensch, der andere ist eine Maschine. Die Versuchsperson kann jetzt Fragen an beide stellen, und muss am Ende entscheiden, wer die Maschine ist. Gelingt es der Versuchsperson nicht, die Maschine zu “enttarnen”, muss man nach diesem Test der Maschine die Fähigkeit zu denken zubilligen.

Bei einem Web-Formular kann man natürlich nicht mit menschlichen Versuchspersonen arbeiten, man braucht sozusagen eine automatisierte Fassung des Turing-Tests. (Wie ironisch es ist, dass man ein Verfahren automatisieren muss, um eine andere Automatisierung sinnvoll zu unterbinden, sei hier nur am Rande bemerkt.)

Man entwickelte also “vollständig automatisierte öffentliche Turing-Tests, um Computer und Menschen zu unterscheiden” oder “Completely Automated Public Turing tests to tell Computers and Humans apart” - kurz CAPTCHA.

Sauklaue mit Hintersinn

Wie bereits erwähnt, besteht die Hürde in dieser Variante eines Turing-Tests darin, eine Aufgabe zu erfüllen, die für einen Menschen leicht ist, für ein automatisiertes System hingegen sehr schwer bis unmöglich. Eine früher häufig benutzte Variante ist das Erkennen von schlecht zu lesendem Text. Menschen sind sehr gut darin, Muster zu erkennen. Es fällt uns, wenn wir einmal Lesen gelernt haben, in der Regel leicht Buchstaben zu identifizieren. Dabei ist es egal, in welcher Schriftart das “A” ist, vor welchem Hintergrund es zu sehen ist, und ob es vielleicht gedehnt, verdreht oder sonstwie verzerrt ist. Computern fiel das lange ziemlich schwer.

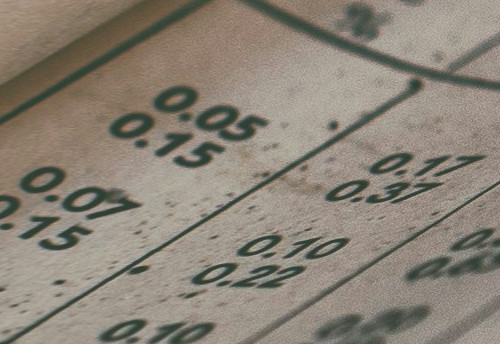

Folgerichtig sahen sich in früheren Jahren die Menschen im Internet häufig damit konfrontiert, Buchstabenfolgen, die in irgendeiner Form nicht ideal lesbar waren, zu entziffern und abzutippen. Nur wer feststellen konnte, dass auf dem kleinen Bildchen zum Beispiel “TaH6” zu lesen stand, wurde als menschlicher Benutzer akzeptiert. Auf dieser Basis gab es noch verschiedene Varianten. Beispielsweise konnte der zu entziffernde Text eine einfache Rechenaufgabe darstellen, die man noch zusätzlich lösen musste.

Einer der Pioniere des CAPTCHA war Luis von Ahn. 2007 kam von Ahn dann auf die Idee, die vielen kleinen Arbeitsleistungen der menschlichen Benutzer noch sinnvoller zu verwenden. Das Lösen eines CAPTCHAs mag nur Sekunden dauern, aber zusammengerechnet verbrachten die Internet-Benutzer insgesamt zigtausende Stunden pro Tag damit.

Was wäre nun, wenn das Lösen eines CAPTCHAs nicht “nur” testen würde, ob der Proband tatsächlich ein Mensch ist? Was wäre, wenn man mit jedem CAPTCHA einen kleinen Teil zu einer sinnvollen Aufgabe beitragen könnte? Damals war die Digitalisierung von physischen Büchern ein großes Thema. Man könnte doch in einem CAPTCHA einen kleinen Ausschnitt aus einem eingescannten Buch zeigen, mit dem die Texterkennungssoftware überfordert ist. Ein Mensch sollte das kurze Textfragment ohne große Schwierigkeiten lesen können, damit beweisen, dass er ein Mensch ist - und gleichzeitig ein kleines Stückchen zur korrekten Digitalisierung des Buchs beitragen.

Von Ahn realisierte dieses Prinzip unter dem Namen “reCAPTCHA”. Die dazugehörige Firma wurde 2009 von Google gekauft. In der Folge entzifferten die menschlichen Benutzer vieltausendfach kleine Textfragmente aus alten Büchern.

Erkläre der KI die Welt

Später begannen Google und andere Anbieter, diesen “Doppelnutzen” auch für andere Zwecke zu verwenden. Beispielsweise bekam die Nutzer Fotos von verschnörkelten Hausnummern oder von Straßenschildern zu sehen, und die Ergebnisse flossen in Kartendienste ein.

Bei einer anderen Variante kommt die KI wieder ins Spiel. Viele Verfahren der KI benötigen enorme Datenmengen. Nehmen wir beispielsweise einen Klassifikator, der anhand eines Fotos sagen soll, ob darauf ein Hund oder eine Katze zu sehen ist. So ein Klassifikator wird trainiert mit einer großen Zahl an Beispielfotos, bei denen man jeweils dazuschreibt “das ist ein Hund” oder “das ist eine Katze”. Mit jedem Foto lernt der Klassifikator ein klein weniger besser zu unterscheiden.

Und wenn wir von einer großen Zahl an Beispielfotos sprechen, meinen wir eine richtig große Zahl. In diesem Bereich sind einige zig Millionen Trainings-Datensätze keine Seltenheit. Und diese zig Millionen Fotos von Hunden oder Katzen wollen auch erst mal korrekt beschriftet sein, damit der Klassifikator anschließend korrekt damit trainiert werden kann. Auch diese Aufgabe wurde an Menschen, die CAPTCHAs lösten, ausgelagert.

Entsprechend bestand die Aufgabe, die ein Mensch beim Lösen eines CAPTCHAs absolvieren musste, dann darin, unter einer Reihe von Fotos diejenigen auszuwählen, die beispielsweise einen Hund, eine Katze, einen Löwen oder einen Lastwagen zeigen.

Ungefähr zu dieser Zeit wurden selbstfahrende Autos ein großes Thema, und auch die brauchten natürlich Trainingsdaten: Was von dem, was die Kameras aufnehmen, ist ein Verkehrsschild, was ist ein anderes Auto, was ein Fußgänger oder Radfahrer? Und so stammen heute viele der Bilder, die man beim Lösen eines CAPTCHAs beurteilen soll, aus dem Straßenverkehr. Wenn man denn noch Bilder gezeigt bekommt.

CAPTCHA hinter den Kulissen

Mittlerweile bekommt man bei vielen CAPTCHAs nämlich gar keine explizite Aufgabe mehr gestellt. Die Unterscheidung zwischen Mensch und Maschine wird stattdessen auf die Beobachtung des Verhaltens gestützt. Der Benutzer muss einfach nur eine Checkbox anklicken, um zu bestätigen “I’m not a robot”. Hinter den Kulissen wird dabei sein Verhalten analysiert, insbesondere wie genau der Mauszeiger kurz vor dem Anklicken der Checkbox bewegt wurde. Nur wenn diese Analyse keine hinreichend sichere Entscheidung zwischen Mensch und Maschine erlaubt, bekommt der Benutzer doch wieder Bilder präsentiert.

Diese Form des CAPTCHAs bieten natürlich auch ihre Stolperfallen. Eines der potentiellen Probleme liegt im Datenschutzrecht. Das bereits erwähnte reCAPTCHA wird von einer amerikanischen Firma, nämlich Google, angeboten, und setzt die Übertragung von Verhaltensdaten an amerikanische Server voraus. Ob und unter welchen Voraussetzungen das so einfach kompatibel mit der DSGVO ist, soll an dieser Stelle den Juristen überlassen bleiben.

Und wie geht es weiter?

Eine der treibenden Kräfte bei der Weiterentwicklung von CAPTCHAs waren, wie bereits erwähnt, die zusätzlichen Nutzen, die man aus den kleinen Aufgaben, die den Internet-Nutzern gestellt wurden, ziehen konnte. Eine andere war die Weiterentwicklung der KI. Was ein automatisiertes System noch vor ein paar Jahren vor ziemliche Probleme gestellt hat, ist heute im Zeitalter von ChatGPT & Co. keine ernstzunehmende Hürde mehr. Damit taugen viele der frühen CAPTCHA-Versionen, und auch einige relativ aktuelle, nicht mehr dafür, ihre eigentliche Aufgabe zu erfüllen, nämlich automatisierte Systeme von Missbrauch von Web-Formularen abzuhalten. Tatsächlich kann zum Beispiel ein KI-gestützer Chatbot vom Microsoft ohne größere Schwierigkeiten die herkömmlichen verzerrten Texte lesen - solange man die Tatsache, dass es sich um Captcha handelt, vor dem Chatbot versteckt.

Wie geht es also jetzt weiter? Müssen wir bald wieder mit massenhaftem Spam leben, oder wird es einen Nachfolger der CAPTCHAs geben? Es gibt bereits einige Vorschläge, aber bisher hat sich noch kein favorisierter Nachfolger herauskristallisiert.